作者 | 樊雅婷

邮箱 | fanyating@pingwest.com

We are approaching the endgame for robotics.And this is just a beginning.

Genesis AI 在X上说我们正在接近机器人技术的终极阶段。

虽然现在仅仅是开始,但也已经开始。

5月6日,Genesis AI发布首个机器人基础模型GENE-26.5,能以1倍真实世界速度,在烹饪、移液、解魔方、线束组装等高难度任务中展现双手精细操作、工具使用与多物体协同能力。

在demo里,GENE-26.5能做番茄炒蛋、制作奶昔、实现精细实验步骤、帮忙插吸管,甚至还能弹钢琴,这一套下来,GENE-26.5已经打败许多真实人类。

视频里,蛋液流手上了还知道用抹布擦,居然还有摩挲的动作,高度类人。就好像它是一个爱干净的人类,在确认到底“擦干净了没有”。

如果说大语言模型在文本知识的处理上已对人类形成碾压,那么GENE-26.5的发布,则预示着这种差距正从认知维度向物理的操作维度蔓延。

它能做到你做不到的事情,全能脑又进化到灵巧手。

其实这家公司的名字很多人可能听过。2024年底,一个叫Genesis的开源物理引擎在GitHub上炸开了锅——用一句话就能生成完整的4D物理世界,成了GitHub上最大的具身智能开源项目。当时的项目牵头人是周衔,卡内基梅隆大学机器人学博士,师从Katerina Fragkiadaki教授,研究方向涵盖世界模型、模仿学习和强化学习。

2024年12月,周衔与同样毕业于CMU的Théophile Gervet——前Mistral AI多模态模型负责人、Skild AI创始成员,共同创立了Genesis AI。2025年7月,公司宣布完成1.05亿美元种子轮融资,由Khosla Ventures和Eclipse联合领投,谷歌前董事长Eric Schmidt、欧洲科技大亨Xavier Niel、法国国家投资银行BPI以及红杉中国等参投。这个数字创下了硅谷具身智能行业种子轮融资纪录,也是硅谷历史上华人团队完成的最大规模种子轮。创始团队约20人,平均年龄不到28岁。

融资之后,沉默了将近一年。

5月6日,他们终于交出了第一份答卷。

1

一、物理世界操作的数字记录

回到GENE-26.5产品本身,对于这些测试场景,官方从spatial precision(空间精度) 、temporal composition(时间编排)、contact richness(接触丰富度)、contact coordination(接触协同度)、tool-mediated interaction(工具中介交互)五个维度进行评估。不难发现,即使是一些高难度的场景,这只手都有很好的表现。

没有人不被这次的Demo视频吸引。这不奇怪,过去我们看了那么多机器人笨拙的走路、无法协调的身体、或者在真实场景下慢得像0.5倍速播放的混乱画面。GENE-26.5的流畅,是扎眼的。更何况它既能切菜、做实验还能弹钢琴,使用场景不仅丰富,还兼顾艺术和实用。

但这种流畅是怎么做到的,又如何实现操作智能的规模化?官方给出了详解。

先看数据。大语言模型和多模态模型走到今天,靠的是吃不完的文本和图片。那是万亿级的数据盛宴。

操作智能面对的是另一张桌子。Genesis在技术博客开篇给了一个数字:超过80%的体力劳动是搬运和操作,但这些技能几乎没有任何数字化记录。

一个流水线工人怎么拧螺丝、一个厨师怎么翻锅、一个实验室技术员怎么移液,这些行为没有被系统地记录下来。过程里有拧螺丝的调整、翻锅时火候的把握,以及移液时周边环境的差异,这些都是很难记录的。

如果去刻意记录,采集数据这件事本身也会干扰工作。

就像你给工人戴上一副复杂的数据手套,他的动作立刻变了,效率不仅会降,拧螺丝的手感也被分走了。采集到的,已经不是原来那个动作了。

1

二、数据引擎:三条线覆盖帕累托前沿

但Genesis说"数据采集不能改变被采集者的行为"。

所以怎么做?答案是三条数据线同时跑。

第一,手套数据。自己做一副数据采集手套,用电磁场追踪指尖位置,手掌和手指覆盖密集触觉传感器。这副手套的设计目标很明确:尽量不干扰正常操作。人们戴着它干活,动作不需要改变,数据自然就流进来了。这是高质量、低数量的线。

第二,以自我为中心的视频。头戴摄像头的第一视角拍摄。这种数据精度不如手套,但能捕捉到真实环境里的任务多样性,而且采集成本极低。这是中等质量、中等数量的线。

第三,互联网视频。YouTube上做饭的视频、修东西的视频、工厂操作的教学视频。精度最低,但规模几乎无限。这是低质量、海量数量的线。

三条线一起,覆盖了数据质量-数量的帕累托前沿。

1

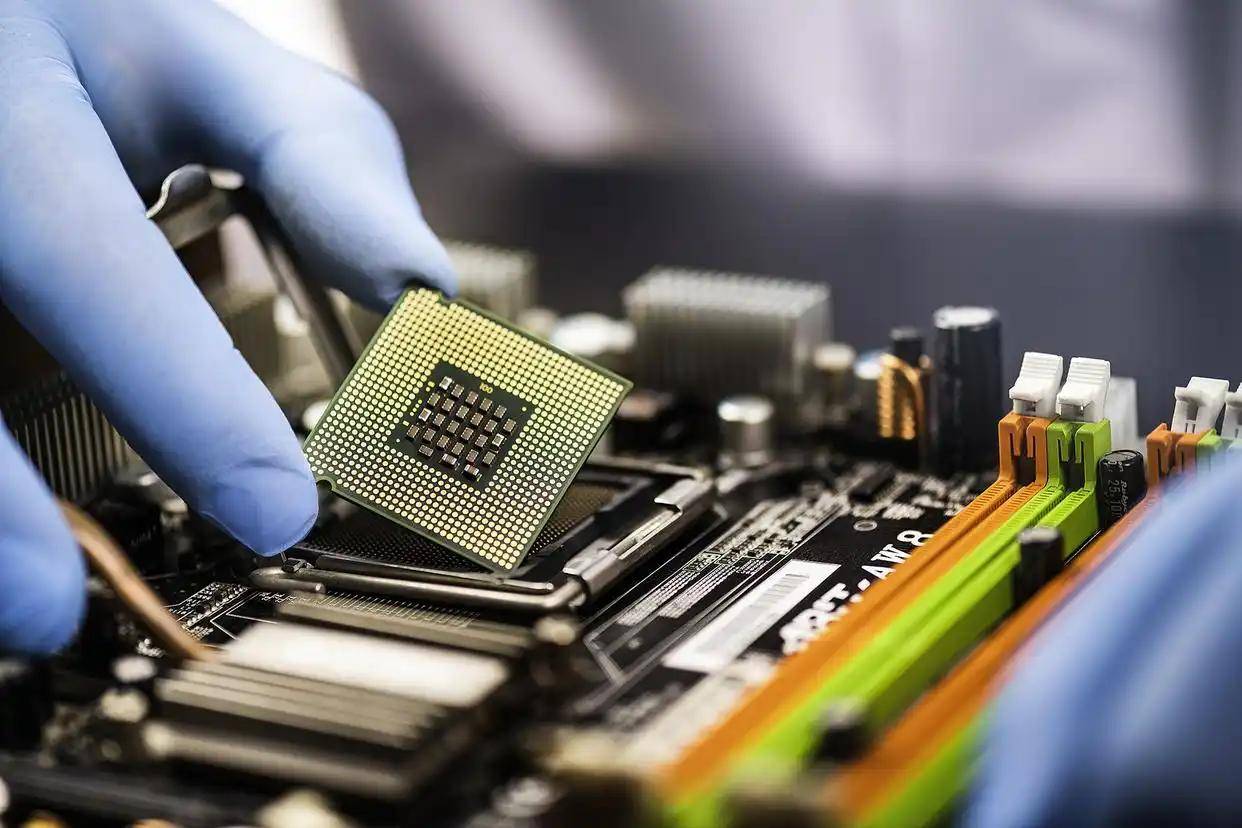

三、硬件不是下游环节,是数据的关键

市面上大多数机器人公司不造手。他们用采购来的硬件,在上面写软件。

Genesis则反过来。

原因不复杂。人戴着手套采集到的动作数据,要喂给机械手去执行。如果这两只手长得不一样——手指长度差一截,关节活动角度对不上,表面一个硬一个软——数据从人手传到机器手,中间必须经过一道翻译。翻译就一定有损耗。手指角度对不齐,力控方式变了,触觉反馈传不过去。采集得再精细,执行端已经走样了。

所以他们自己造了一只。Genesis Hand 1.0,20个自由度,直驱,可反向驱动。尺寸跟真人手1:1匹配。手掌和手指表面覆盖柔软材料,模拟人皮肤的接触物理特性。

1:1尺寸匹配意味着人手怎么动,机械手就怎么动,数据和部署之间是同构的。软材料意味着接触物理特性跟人手接近,人拿起一个鸡蛋的力道,机械手拿起来也是差不多的力道。用他们官方的说法,这叫“近无损信息传递”。

这条逻辑链很清楚:硬件的仿生程度,直接决定了人类数据能不能被模型完整吸收。硬件不是模型的配角,它是数据管道的第一环。

图为Genesis Hand 1.0

1

四、模型架构:把所有东西放进一个联合分布

有了数据,第二个问题是怎么训练。

大多数机器人模型是模块化的。一个模型处理视觉,一个模型处理语言指令,一个模型输出动作。模块之间要对齐,对齐就有信息损耗。

Genesis的做法又不一样。他们的目标是学习一个统一的联合分布,把所有东西放进去:语言、视觉、本体感觉、触觉、动作。用流匹配来建模轨迹上的联合分布,同时保留时间维度的耦合关系。

这个东西的实用效果是你在训练的时候不需要显式地对齐不同模态。模型自己学会了——当视觉出现某个模式、触觉出现某个模式的时候,对应的动作应该是什么。缺失的模态可以通过去噪来推断。

而且这个联合分布可以灵活地接入外部模型。VLM(视觉语言模型)给它提供语义理解,世界模型(动作条件视频生成)给它提供物理预测能力。联合分布同时吸收这两者,但不依赖其中任何一个。

1

五、评估的缩放:为什么2700小时能只用仿真

模型练出来了,下一步是判卷子。但判卷子比出卷子更耗时。

Genesis给了一个数字:如果在真实世界里跑完所有评估,需要人-机器人交互2700个小时。这在物理上几乎不可行。

于是他们把考场搬进了仿真环境。Genesis World,他们打磨了一年多,能模拟光照变化、背景替换、物体属性偏移、场景配置重组。每个数据点背后是200套评估设置、超过150小时的机器人执行时间,仿真把它压缩到了可操作的范围里。

关键发现是:预训练数据规模越大,模型在从未见过的新场景里表现越好。这条曲线,跟大语言模型的缩放规律长得一样。更大的模型、更多的数据、更多的算力,验证损失持续降低。

或许这才是他们真正想让行业看到的东西。一条在仿真里初步成立的Scaling Law曲线,在真实物理世界里被复现。

官方还提到:在即将到来的版本中,他们将分享关于Genesis World的更新,以及如何在模拟和现实世界中的模型评估之间建立强大的相关性。

In our upcoming release, we will share an exciting update on Genesis World and how we establish strong correlation between model evaluation in simulation and real world.

1

结语

融资之后,沉默一年。Genesis再次露面,直接往物理世界扔了一只手。

自己设计的数据手套,自己造的机械手,自己写的控制器,自己搭的仿真环境。这套全栈系统让Genesis拥有了极高的控制力。

但也有些问题需要进一步解答。例如它能多大程度地适应现实世界的详细场景?又例如在产品形态上,能不能再imaginative一点,不再只是实验室里的一只机械手?

大语言模型走到今天,底层是一条被反复验证过的信念:更大模型、更多数据,性能就会一直涨。这是LLM的Scaling Law,行业信它,资本也信它。但物理世界还没有摸到属于自己的那条线。

事实上,世界模型至今仍是一个混沌的战场。所有人都在抢入场券,却没几个人能说清它到底是什么。

但GENE-26.5的出现可能会改变这件事。它用一只仿生手,一套仿真引擎,把理解物理世界这个模糊命题锚定到了更加具体、且可评测的维度上。它让规模化看起来不再是口号。Genesis World的评估结果,也许正是物理世界Scaling Law最早的信号,也可能不是。时间会给出答案。

但不管怎样,这套全栈系统瞄准的方向是清楚的,就是让机器人在物理世界里像人一样感知、适应、操作,而不是在预设脚本里重复。

点个“爱心”,再走 吧

京公网安备 11011402013531号

京公网安备 11011402013531号