2026年,已经炙热的人工智能领域正在孕育着新一轮的增长点。来自全球调研机构弗若斯特沙利文(Frost & Sullivan)的预测,全球端侧 AI 市场规模将从2025 年的3219 亿美元,以年复合增长率40%的强劲势头,在2029年达到1.22万亿美元。

面对端侧AI市场井喷式的增长态势,在3月19日深圳召开的“华为中国合作伙伴大会2026”上,华为与北京面壁智能携手分享了双方在端侧大模型领域深度合作的成功经验。双方希望借助面壁小钢炮MiniCPM系列模型基于昇腾平台的优异性能表现,给端侧AI产业的发展,提供一个“新的选择”。

面壁智能带来端侧AI新主张 造就大模型新趋势

目前,大模型的发展都在遵循规模法则(Scaling Law),它所体现的是随着模型、数据集以及计算资源的增加而变化的一种经验性规律。面壁智能联合创始人&COO雷升涛指出,一味遵循规模法则,将会在算力效能、整体耗能等多方面给中国AI产业的发展带来一系列挑战。

而面壁智能所提出的密度法则(Densing Law),为业界提供了一个解读规模法则的中国视角。密度法则指出,大模型知识密度每3.3个月将会翻一番,大模型将变得越来越“小”,即实现相同能力所需参数量仅为原先的一半,同时,大模型的能力也更强。面壁智能的密度法则,一方面涵盖了规模法则原有所包含的算力、算法与数据,这三个关键要素,同时也揭示出,以知识密度的视角,大模型完全可以在限定的算力范围之内,凭借对算法、架构以及数据资源的创新,提升整体大模型的性能。

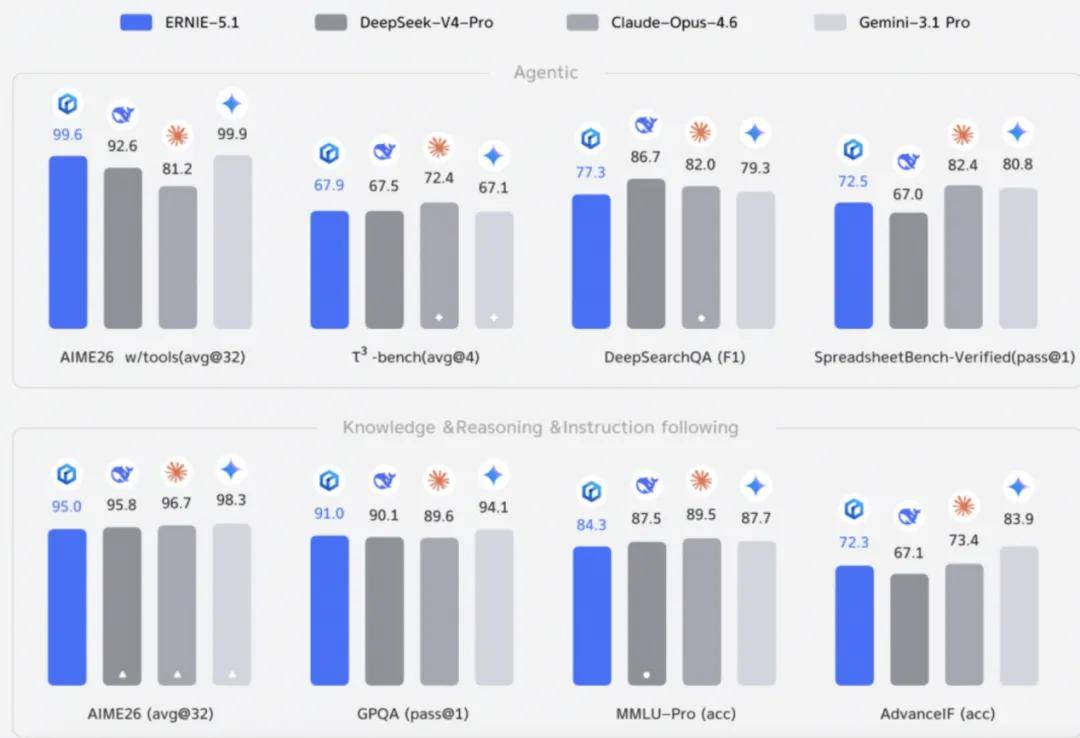

也正是基于“密度法则”,面壁智能在自身所专注的端侧智能领域,在业界取得了显著的领先地位。在昇腾平台上,面壁小钢炮MiniCPM系列模型所实现的性能表现,即测评跑分数据达到了当前业界同行的1.1倍左右。凭借“以小博大”的卓越端侧表现,面壁智能MiniCPM 端侧大模型在开源社区受到广泛赞誉,接连登顶 GitHub、Hugging Face 热度榜。

面壁智能取得如此亮眼的性能表现,华为制造与大企业军团软件与ICT企业总经理孙健认为,其有力地证明了自主创新智算算力完全能够胜任端侧大模型的需求。孙健说到:“面壁智能和华为两个团队的深度合作,不仅验证了自研算力和端侧模型这条路能走通。同时,这也给行业确立了信心,那就是软硬一体自主创新的AI路径,在端侧模型领域也是完全能走通的。”

全栈深度协作 昇腾与面壁打造端侧AI新标杆

对于面壁智能所聚焦的端侧大模型领域,模型落地成功与否,关键在于与算力芯片的高度适配。与云端大模型的应用场景不同,面壁智能端侧大模型在自动驾驶、智能家居等领域的场景中应用,对算力、内存的消耗,以及整体功耗的要求都极为严苛。雷升涛指出:“经过跟昇腾的深度协同,面壁智能端侧大模型实现了模型运行速度更快、推理效率更高、功耗更低的目标。”

华为与面壁智能的成功“牵手”,孙健认为这得益于华为一直遵循的“硬件开放、软件开源”的战略定位。这一战略的持续推进,使昇腾能够更好地助力自主创新大模型充分释放潜能。

在这一战略定位的驱动下,华为与面壁智能自2024年便开展紧密合作。合作过程可分为三个重要阶段。

在起始阶段,昇腾算力首先要实现与面壁智能端侧大模型的全面适配。这一阶段是模型后续优化,迭代升级的基础。在第二阶段,面壁智能、华为双方围绕算力融合,底层深度调优,例如内存复用等方面展开深度合作,确保面壁智能端侧大模型整体性能的持续优化。在实现优化的基础上,双方进入到系统层,围绕模型整体性能提升的第三阶段工作。在这个过程中,双方的“深度合作”覆盖了从指令集到算子调优等多个方面。

双方携手合作期间,华为将自研的高带宽、低功耗的存储协议应用于面壁智能端侧大模型的适配过程中,有效提升了端侧大模型的性能表现。雷升涛表示:“面壁智能的MiniCPM 4.0B和8B版本,在实际测试过程中,首次时延降低了约40%,能效实际提升接近2倍。”

华为+面壁智能 造就中国端侧AI新范式

端侧大模型的应用场景非常丰富,面壁智能将与华为一道,从零日适配到模型的最终发布,进行紧密合作。最终,双方能够以更快的交付速度、更高的服务质量,更好地服务共同的客户和市场。

目前,面壁智能已经在汽车、手机以及智能家居等领域的端侧大模型应用场景中取得了优异的成绩。雷升涛介绍:“当下,市面上很多款量产乘用车,都已经在智能驾驶、智能座舱等场景中应用面壁智能的端侧大模型。”

孙健指出,华为与面壁智能团队深度合作所取得的成果,对于中国端侧AI领域的发展,具有里程碑式的示范意义——即实现了自研领先算力底座与自研领先端侧大模型之间的深度适配。面壁智能与华为的成功实践,从三个维度给中国端侧AI树立起新范式。

首先,面壁智能与华为实践出了“算力+模型”,在端侧大模型领域中全栈自主的闭环成功路径。在这一过程中,面壁智能与华为仅通过国内算力硬件和生态资源,验证了自主“算力+模型”范式在端侧AI领域,不仅可用,而且好用。

其次,通过双方的深度协作,为业界打造出能够充分释放算力潜能的端侧大模型高度软硬协同的新标准。双方的合作不仅是简单的软硬移植、适配,更是软硬深度的耦合与协同。这种深度适配才能让面壁小钢炮MiniCPM系列模型在昇腾平台上,取得超越同等规模其他芯片的性能表现,同时功耗也得到明显下降。

第三个维度,则是双方的合作降低了AI开发者,尤其端侧AI开发者的进入门槛。从而进一步激活了华为与伙伴所构建的开源、开放的生态。华为仍将遵循“硬件开放,软件开源”这一战略,全力助力伙伴释放AI在众多场景中的潜能。

华为四个维度“释放”新范式价值 助力伙伴赢得AI机遇

AI正处在一个爆发式成长的过程之中。昇腾作为智算算力底座,首要责任就是为从事AI模型开发的软件高科技企业做好模型“匹配”与“适配”的工作。为了更好地胜任这一角色,华为主要围绕四个层面展开工作。

首先,华为将持续专注自身算力的迭代升级,以及在迭代过程中对不同模型实现完美适配。与此同时,华为还将不断精进自身在智算算力集群领域的能力,例如华为目前所提供的昇腾384超节点,以及未来将推出的昇腾8192超节点。这一系列工作的核心目的,是为伙伴提供一个坚实可靠、性能优越的智算算力基座。

此外,为了有效助力合作伙伴,华为实现了全栈工具链的开放。华为将这些工具开放给从事AI领域的软件高科技企业,从而便于这些企业更好地发挥华为的AI算力。

第三个层面,华为将与领先的软件企业建立生态伙伴关系,实现深度合作。面壁智能便是华为生态伙伴中的优秀代表。在端侧AI领域,面壁智能也在为生态贡献并分享其工具,以便不断推动端侧AI应用的发展。

最后,华为基于与伙伴展开的紧密、高效的全栈式合作,最终为客户提供一个开放、领先、安全的AI业务新范式。

基于这四个层面,华为与伙伴一道协力,加速助力为最终客户提供从技术研发到产品商业落地的全流程、全生命周期AI解决方案。

端侧 AI 的黄金时代已至,华为与面壁智能的深度携手,以“密度法则”为指引,通过从芯片到模型的软硬一体创新,实现了自主创新的 “算力 + 模型” 闭环的行业新范式。未来,华为依然将坚守打造坚实算力基座的使命,与伙伴一道让 AI 技术落地千行百业,共同推动中国 AI 产业走向全球领先。

京公网安备 11011402013531号

京公网安备 11011402013531号